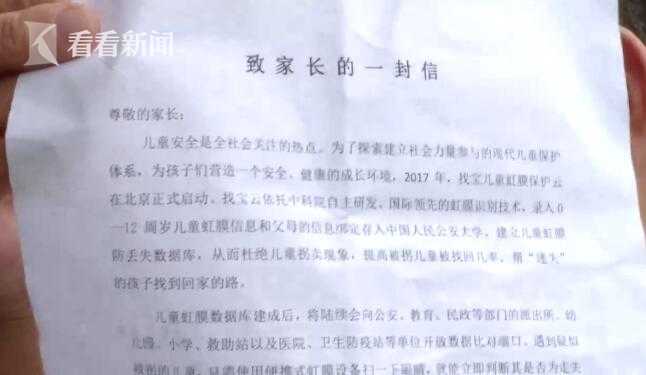

家住深圳龙岗区的李女士反映,说她家孩子从幼儿园带回来一封信,信中称,一家位于上海的科技公司可以利用虹膜识别技术,录入0-12岁儿童的虹膜信息,和父母的信息绑定存入该公司的数据库。儿童虹膜数据库建成后,将陆续向公安、教育、民政等部门开放数据比对端口,从而杜绝儿童拐卖现象,提高被拐儿童被找回的几率,最终实现“天下无拐”。

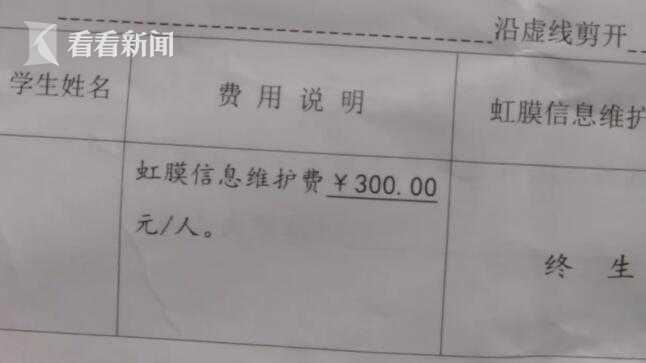

李女士左思右想,总感觉有些不妥。录入孩子的虹膜信息,同时绑定了家长的信息,“这一个企业会不会把我们的信息泄露,会存在一定的风险吧。毕竟也要家长信息录入,而且也不是公益项目,是收费300。”

采集个人生物信息并建立数据库已经从单纯的生物信息贮存和利用,上升到人工智能(AI)的研发和利用。就像人类基因组计划实施以来,很多公司对个人DNA样本的收集和贮存呈现疯狂竞争的状态,只要有DNA样本就予以收集。因为,生物信息和大量的样本是最好的资源,既是AI研发的基础,又具有巨大的商业价值,如新药和医疗器械的研究、个体识别的利用等,能为研发和使用者带来巨大利益。

但是,另一方面,个人生物信息的采集又将更多的公民置于不安全的境地,如果个人的DNA信息泄露,将在求职、婚恋、保险方面受到歧视和刁难,更重要的是,未来还可能成为研制生物武器的基础。

虹膜信息如同人的DNA信息一样,既是唯一的,也是宝贵的,而且孩子的虹膜信息还与家长的个人信息共同绑定,一旦泄露,比个人DNA信息泄漏隐患还要大。同样重要的是,虹膜信息也如同DNA资源一样,是个人的财富,如果有公司采集后从事商业活动以获取利润,提供虹膜信息者也应当像提供DNA资源者一样,获得利益的分享。但是,从这家公司的做法来看,不仅没有提供这样的保证,还要求家长交费(以保护孩子丢失为理由),就显得采集虹膜信息的不合理,至少是底气不足。

可以看到,在AI时代,很多技术公司都在加快速地跑马圈地和巧立名目,以便为未来的AI项目研发和应用赢得商机和占领市场,除了DNA样本,虹膜、人脸等也成为重要的生物信息资源。

然而,眼下许多技术公司和政府部门以各种名目收集个人的生物信息,也造成了公民的不安和反对,并提出了要将这样的行为纳入到人类的伦理和法律规范中,这无疑也是上述那位母亲的直觉,显然,这样的直觉是对的,也非常及时。因为,在面对公众和社会的普世价值面前,很多公共机构、全球知名的技术企业等也已意识到问题的严重性,并提出了一系列AI研发和使用的伦理原则。

美国信息技术产业委员会(ITI)在2017年就颁布了人工智能的14条政策准则。2019年4月初,欧盟又出台了AI系统应该满足的七大原则。而在此之前,欧盟还出台了史上最严格的数据保护条例——《通用数据保护条例》(GDPR),旨在加强对数据的保护,而AI正是以大数据为基础和“养料”。

在这些原则中,都所见略同地提出了对个人信息,无论是数据信息还是生物信息的收集和利用都应当首先要有知情同意,同时提出,AI不应该践踏人类的自主性,人们不应该被AI系统所操纵或胁迫,应该能够干预或监督软件所做的每一个决定,同时要保证个人信息的安全,防止隐私泄露,以及保证所收集的个人信息用于AI技术的可靠性。

中国人工智能学会(民政部注册的中国智能科学技术领域唯一的国家级学会)伦理道德专业委员会也在接受委托,计划针对不同行业,首先设置一系列伦理规范,如智能驾驶规范、数据伦理规范、智慧医疗伦理规范、智能制造规范、助老机器人规范等,之后再逐步扩展到其他行业部门。

其实,在所有关于AI的伦理原则中,第一个原则是应当像人类基因组计划倡导的伦理原则一样,知情同意。对于收集公众的无论是数据、隐私,还是生物信息,如DNA和虹膜等,都首先要让公众知情同意,其次才谈得到AI使用中对个人隐私的保护、技术的可靠性,以及不能将个人信息收集来作为监控公民的手段。

现在,对于一家公司收集深圳这家幼儿园孩子的虹膜信息,幼儿园方面称,已经接到了区教育部门的指令,了解到该活动违反了主管部门的有关规定,将立即停止。虽然违反了什么规定语焉不详,但也意味着,未来这类以保护孩子为名收集个人生物信息的行动必须纳入AI和个人生物信息的伦理和法规保护之下,而且,希望中国在这方面的立法越早越好。

总体而言,将AI研发和利用置于公众的监督之下,获得公众的知情同意,要保护公众隐私,同时要利益分享。(张田勘)

快乐骑行 低碳...

快乐骑行 低碳... 千城百县看中...

千城百县看中... 走!周末去滑雪

走!周末去滑雪 河北固安:鲜...

河北固安:鲜... 河北石家庄:...

河北石家庄:... 河北保定:清...

河北保定:清... 微纪录片丨问...

微纪录片丨问... 雄安上新啦①...

雄安上新啦①... 长城访谈丨唐...

长城访谈丨唐... 天下无诈 | 取...

天下无诈 | 取... 河北藁城:公...

河北藁城:公... 微纪录片丨问...

微纪录片丨问...